Uploaded by

Felipe Trujillo Garzon

Taller de Econometría 1: Máxima Verosimilitud y Mínimos Cuadrados

advertisement

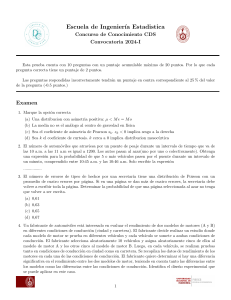

Universidad Nacional de Colombia Facultad de Ciencias Económicas Econometrı́a 1 Cuarto Taller 1. (Máxima Verosimilitud). Una variable aleatoria x sigue la distribución exponencial si presenta la siguiente función de densidad de probabilidad (pdf): 1 exp − x si x ≥ 0, θ f (x) = θ (1) 0 si x < 0. Donde θ > 0 es el parámetro de la distribución. Con el métodoP de Máxima Verosixi , donde n es el militud (MV) demuestre que el estimador de MV de θ es θb = n tamaño de la muestra. Es decir, demuestre que el estimador de MV de θ es la media muestral x̄. Como estamos interesados en el caso en que x ≥ 0, la función de densidad es: x 1 . f (x) = exp − θ θ La función de verosimilitud serı́a: L (x1 , x2 , . . . , xn ; θ) = n Y 1 i=1 x i exp − , θ θ n 1 1X = n exp − xi θ θ i=1 Tomando logaritmo natural a la función de verosimilitud, n 1X ln(L) = −nln(θ) − xi . θ i=1 1 ! . 2 Derivando con respecto a θ, igualando a cero y despejando, obtenemos el estimador de Máxima Verosimilitud del parámetro θ. n ∂ln(L) n 1 X =0: − + 2 xi = 0, ∂θ θ θ i=1 n n 1 X = 2 xi , θ θ i=1 Pn θbM V = i=1 xi n = x̄. 2. (Máxima Verosimilitud). Sea x una variable aleatoria discreta que representa el número de aciertos en n ensayos de un experimento. Asuma que la variable x sigue una distribución binomial: n x f (x) = p (1 − p)n−x . (2) x Donde p es la probabilidad de acierto. Demuestre que el estimador de MV de p es x pb = . Es decir, demuestre que el estimador de MV de la probabilidad de acierto n es la variable x dividida entre el número de observaciones. La función de verosimilitud es: n x L (x; p) = p (1 − p)n−x , x x n p = (1 − p)n . x 1−p Tomando logaritmo natural a la función de verosimilitud. p n ln(L) = xln + n ln (1 − p) + ln . 1−p x Derivando con respecto a p, igualando a cero y despejando, encontramos el estimador de Máxima Verosimilitud de ese parámetro. 3 ∂ln(L) =0: ∂p 1−p p x n = 0, 2 − 1−p (1 − p) n x = , 1−p p (1 − p) np = x, pbM V = x . n 3. (Mı́nimos Cuadrados Restringidos). Suponiendo que se cumplen los supuestos b 0 Pb del modelo clásico de regresión. Demuestre que SRCR − SRCN R = u u. Donde P −1 0 0 b es la matriz de proyección, P = X(X X) X , y u son los residuales estimados del modelo restringido. Tips: Utilice las siguientes ayudas: Estadı́stico F en función de SRC y en su forma matricial: Fc = (SRCR − SRCN R )/J , SRCN R /(n − k) −1 (Rb − r) /J (Rb − r)0 R (X0 X)−1 R0 . Fc = 2 s Donde J es número de restricciones lineales en la hipótesis nula, R es una matriz de dimensión J × k, r es un vector de dimensión J × 1 y b es el vector de los parámetros estimados por MCO. El estimador de la varianza de los residuales en el modelo no restringido es s2 , que se define como: SRCN R s2 = . n−k La condición de primer orden del problema de optimización de mı́nimos cuadrados restringidos: h i−1 −1 b = R0 R (X0 X) R0 X0 u (Rb − r) . 4 El primer paso intuitivo es igualar las dos expresiones de los estadı́sticos F. Pero el segundo paso es un poco más difı́cil. Toca desarrollar y organizar de forma conveb 0 Pb niente la expresión u u y hacer uso de la condición de primer orden. Como s2 = SRCN R , el estadı́stico F en su forma matricial queda expresado como: n−k −1 (Rb − r) /J (Rb − r)0 R (X0 X)−1 R0 Fc = . SRCN R /(n − k) Igualando ambas expresiones del estadı́stico F : −1 (Rb − r)0 R (X0 X)−1 R0 (Rb − r) /J (SRCR − SRCN R )/J = Fc = , SRCN R /(n − k) SRCN R /(n − k) h i−1 −1 (Rb − r) . SRCR − SRCN R = (Rb − r)0 R (X0 X) R0 −1 b 0 Pb Como P = X(X0 X) X0 , la expresión u u queda, −1 b 0 Pb b 0 X(X0 X) X0 u b, u u=u −1 b 0 Pb b )0 (X0 X) (X0 u b ). u u = (X0 u h i−1 −1 0 0 b = R R (X X) R Usando la condición de primer orden: X u (Rb − r) y simplificando, tenemos: h 0 h i−1 i−1 −1 −1 −1 0 0 0 0 0 0 0 0 b Pb u u = R R (X X) R (Rb − r) (X X) R R (X X) R (Rb − r) , 0 0 h i−1 h i−1 −1 −1 −1 b 0 Pb (Rb − r) . u u = (Rb − r)0 R (X0 X) R0 R (X0 X) R0 R (X0 X) R0 h 0 −1 Debido a que R (X X) 0 R i−1 −1 R (X0 X) R0 = IJ , h i−1 −1 0 0 b Pb u u = (Rb − r) IJ R (X X) R (Rb − r) , 0 0 h i−1 −1 0 0 b Pb u u = (Rb − r) R (X X) R (Rb − r) . 0 0 5 Entonces, tenemos las siguientes igualdades, h i−1 −1 b 0 Pb u u = (Rb − r)0 R (X0 X) R0 (Rb − r) , h i−1 −1 SRCR − SRCN R = (Rb − r)0 R (X0 X) R0 (Rb − r) . Luego, se obtiene el resultado deseado. h i−1 −1 b 0 Pb SRCR − SRCN R = (Rb − r)0 R (X0 X) R0 (Rb − r) = u u, b 0 Pb SRCR − SRCN R = u u. 4. (Mı́nimos Cuadrados Restringidos). Se estima por medio de MCO un modelo de la variable y sobre un término constante y dos variables control, dando como resultado el modelo no restringido: yb = 4 + 0.4x1 + 0.9x2 . Se conoce la siguiente información: SRCN R = 520, n = 29 y 29 0 0 X0 X = 0 50 10 . 0 10 80 Mediante la fórmula matricial del estadı́stico F, evalúe la hipótesis de que la suma de los estimadores de x1 y x2 es igual a 1. Para hacer el contraste, trabajando con un nivel α = 5 %, con los grados de libertad J = 1 y n − k = 26, el F de las tablas es Ft = 4.225 ¿Qué conclusión obtiene? La función de regresión poblacional es: yi = β0 + β1 xi,1 + β2 xi,2 + ui . La hipótesis nula es: H0 : β1 + β2 = 1. Y el estadı́stico F en su forma matricial es: −1 (Rb − r)0 R (X0 X)−1 R0 (Rb − r) /J . Fc = SRCN R /(n − k) 6 De la hipótesis nula se hace obvio que sólo hay una restricción, por lo que J = 1. Además, el vector r serı́a, en este caso, un escalar: r = 1. También se deduce que la matriz R es un vector de 1 × 3, ya que hay una sola restricción y 3 parámetros: β0 , β1 , y β2 . R= 0 1 1 . La matriz (X0 X)−1 es relativamente fácil de calcular. Con el método de GaussJordan, se puede llegar a la siguiente expresión: 1 0 0 29 1 4 . =0 − 195 390 1 1 0 − 390 78 −1 (X0 X) Desarrollamos la expresión R (X0 X)−1 . 1 0 0 29 4 1 = 0 7 = 0 1 1 − 0 195 390 390 1 1 0 − 390 78 0 −1 R (X X) 2 195 . Desarrollamos la expresión R (X0 X)−1 R0 . −1 0 0 R (X X) R = 0 7 390 2 195 0 1 = 11 . 390 1 i−1 h −1 Luego, la matriz R (X0 X) R0 serı́a, simplemente, el inverso de un escalar. h i−1 11 −1 392 −1 0 0 R (X X) R = = . 390 11 Ahora, desarrollamos la expresión Rb − r, la cual nos da un escalar. Por lo que, en este caso, tenemos (Rb − r)0 = (Rb − r). 7 4 Rb − r = 0 1 1 0.4 − 1 = [0 + 0.4 + 0.9] − 1 = 0.3. 0.9 h i−1 −1 Luego, la expresión (Rb − r)0 R (X0 X) R0 (Rb − r) queda como, h i−1 390 351 −1 0 0 (Rb − r) R (X X) R (Rb − r) = (0.3) (0.3) = . 11 110 0 Con SRCN R = 520 y n − k = 26, la varianza estimada del modelo no restringido es: s2 = 520 SRCN R = = 20. n−k 26 Con esta información, ya se puede calcular el valor del estadı́stico F . −1 (Rb − r)0 R (X0 X)−1 R0 (Rb − r) /J , Fc = SRCN R /(n − k) Fc = 351 (351/110)/1 = ≈ 0.1595. 20 2, 200 Trabajando con un nivel de significancia del 5 %, con J = 1 y n − k = 26 grados de libertad, el valor crı́tico de las tablas es Ft = 4.225. Como Ft > Fc , hay evidencia para no rechazar la hipótesis nula.